Dùng cho cáp BMS, BUS, công nghiệp, thiết bị đo lường.

Elon Musk và nhóm xAI đã chính thức ra mắt phiên bản Grok mới nhất, Grok3, trong một buổi phát trực tiếp. Trước sự kiện này, một lượng lớn thông tin liên quan, cùng với sự cường điệu quảng cáo 24/7 của Musk, đã nâng kỳ vọng toàn cầu về Grok3 lên mức chưa từng có. Chỉ một tuần trước, Musk tự tin tuyên bố trong một buổi phát trực tiếp khi bình luận về DeepSeek R1, "xAI sắp ra mắt một mô hình AI tốt hơn". Từ dữ liệu được trình bày trực tiếp, Grok3 được cho là đã vượt qua tất cả các mô hình chính thống hiện tại về điểm chuẩn cho toán học, khoa học và lập trình, với việc Musk thậm chí còn tuyên bố rằng Grok3 sẽ được sử dụng cho các tác vụ tính toán liên quan đến các sứ mệnh Sao Hỏa của SpaceX, dự đoán "những đột phá ở cấp độ Giải thưởng Nobel trong vòng ba năm". Tuy nhiên, đây hiện chỉ là lời khẳng định của Musk. Sau khi ra mắt, tôi đã thử nghiệm phiên bản beta mới nhất của Grok3 và đặt ra câu hỏi mẹo kinh điển cho các mô hình lớn: "Cái nào lớn hơn, 9.11 hay 9.9?" Thật đáng tiếc, không có bất kỳ điều kiện hoặc dấu hiệu nào, cái gọi là Grok3 thông minh nhất vẫn không thể trả lời đúng câu hỏi này. Grok3 không xác định chính xác ý nghĩa của câu hỏi.

Bài kiểm tra này nhanh chóng thu hút sự chú ý đáng kể từ nhiều bạn bè, và thật trùng hợp, nhiều bài kiểm tra tương tự ở nước ngoài đã chỉ ra rằng Grok3 gặp khó khăn với những câu hỏi vật lý/toán học cơ bản như "Quả bóng nào rơi đầu tiên từ Tháp nghiêng Pisa?" Do đó, nó đã được gắn mác hài hước là "một thiên tài không muốn trả lời những câu hỏi đơn giản".

Grok3 thì tốt, nhưng không tốt hơn R1 hay o1-Pro.

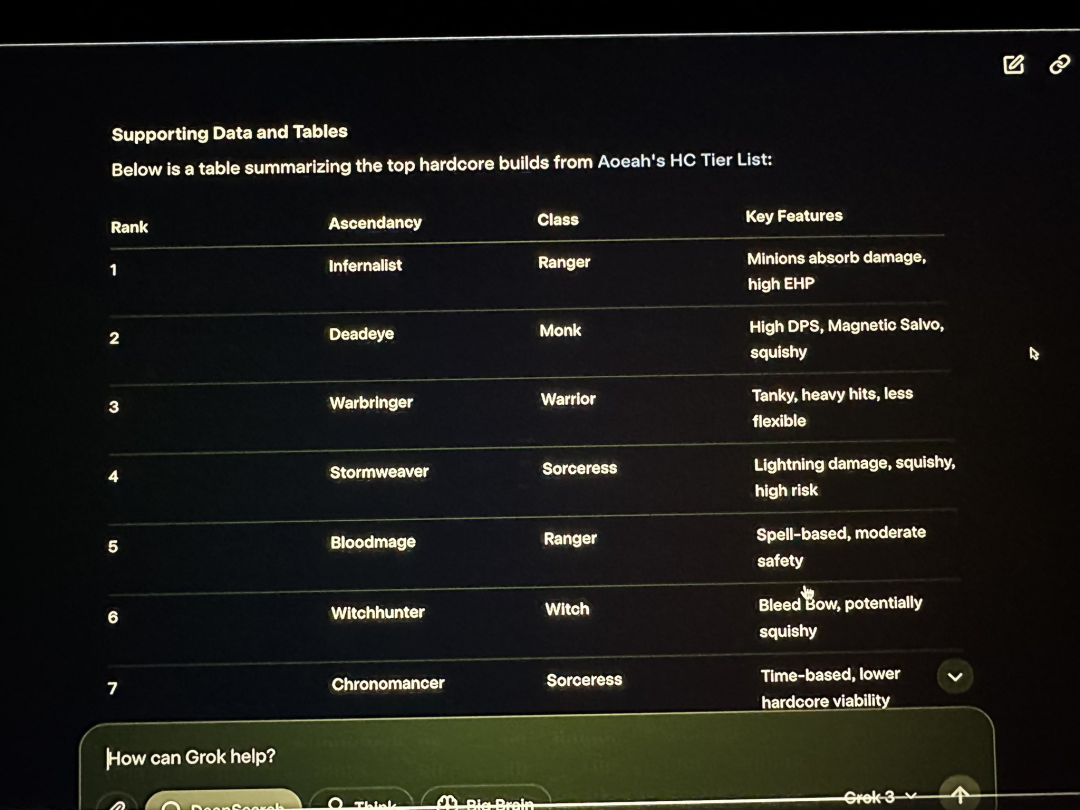

Grok3 đã gặp phải "thất bại" trong nhiều bài kiểm tra kiến thức phổ thông trong thực tế. Trong sự kiện ra mắt xAI, Musk đã trình diễn cách sử dụng Grok3 để phân tích các lớp nhân vật và hiệu ứng từ trò chơi Path of Exile 2, trò chơi mà anh ấy tuyên bố là thường chơi, nhưng hầu hết các câu trả lời mà Grok3 đưa ra đều không chính xác. Musk trong buổi phát trực tiếp đã không nhận thấy vấn đề rõ ràng này.

Sai lầm này không chỉ cung cấp thêm bằng chứng cho cư dân mạng nước ngoài chế giễu Musk vì "tìm người thay thế" trong trò chơi mà còn làm dấy lên mối lo ngại đáng kể về độ tin cậy của Grok3 trong các ứng dụng thực tế. Đối với một "thiên tài" như vậy, bất kể khả năng thực tế của nó, độ tin cậy của nó trong các tình huống ứng dụng cực kỳ phức tạp, chẳng hạn như các nhiệm vụ thám hiểm sao Hỏa, vẫn còn nghi ngờ.

Hiện tại, nhiều người thử nghiệm đã được tiếp cận Grok3 cách đây vài tuần và những người mới thử nghiệm khả năng của mô hình trong vài giờ ngày hôm qua đều đưa ra một kết luận chung: "Grok3 tốt, nhưng không tốt hơn R1 hay o1-Pro".

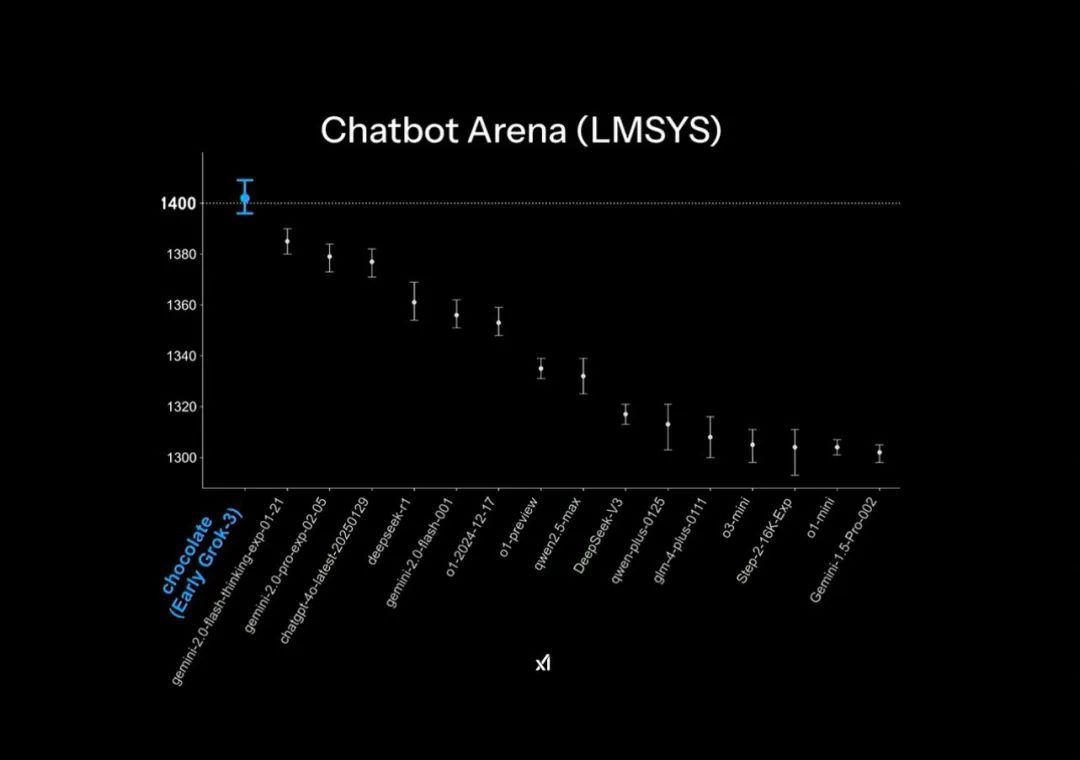

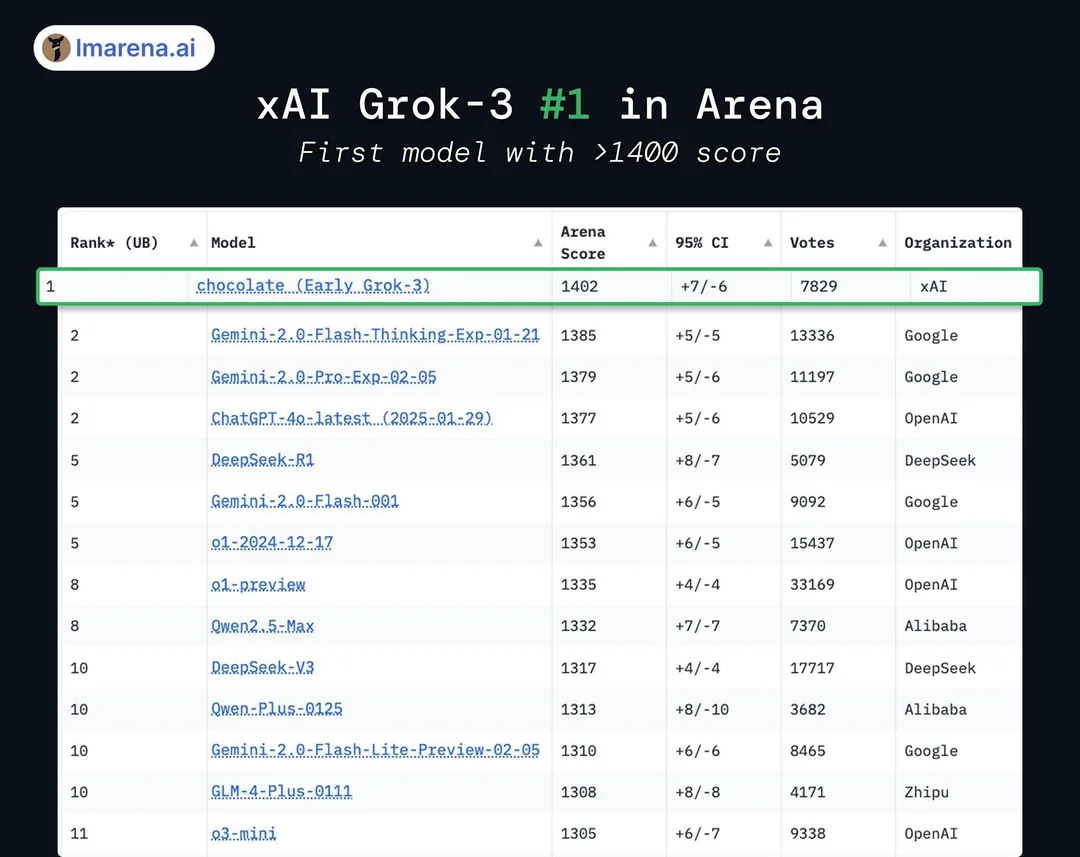

Góc nhìn phê phán về "Làm gián đoạn Nvidia"

Trong PPT chính thức được trình bày trong quá trình phát hành, Grok3 được chứng minh là "vượt xa" trong Chatbot Arena, nhưng đã sử dụng các kỹ thuật đồ họa một cách khéo léo: trục dọc trên bảng xếp hạng chỉ liệt kê các kết quả trong phạm vi điểm 1400-1300, khiến cho sự khác biệt ban đầu là 1% trong kết quả kiểm tra có vẻ đặc biệt đáng kể trong bài thuyết trình này.

Trong kết quả chấm điểm mô hình thực tế, Grok3 chỉ hơn DeepSeek R1 và GPT-4.0 1-2%, tương ứng với trải nghiệm của nhiều người dùng trong các thử nghiệm thực tế cho thấy "không có sự khác biệt đáng chú ý". Grok3 chỉ vượt trội hơn các phiên bản kế nhiệm của nó từ 1%-2%.

Mặc dù Grok3 đạt điểm cao hơn tất cả các mô hình hiện đang được thử nghiệm công khai, nhiều người không coi trọng điều này: xét cho cùng, xAI trước đây đã bị chỉ trích vì "thao túng điểm số" trong kỷ nguyên Grok2. Khi bảng xếp hạng phạt theo phong cách độ dài câu trả lời, điểm số giảm đáng kể, khiến những người trong ngành thường chỉ trích hiện tượng "điểm cao nhưng khả năng thấp".

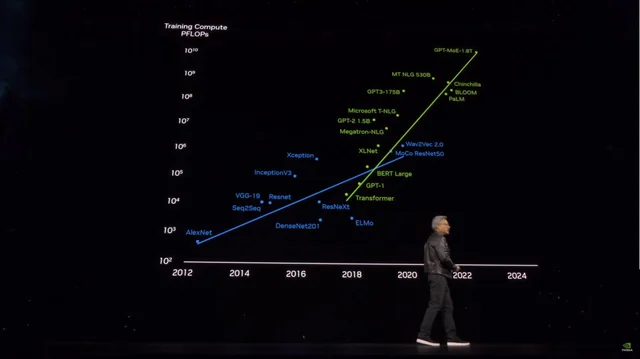

Cho dù thông qua "sự thao túng" bảng xếp hạng hay các thủ thuật thiết kế trong hình minh họa, chúng đều tiết lộ xAI và nỗi ám ảnh của Musk với khái niệm "dẫn đầu" về khả năng của mô hình. Musk đã phải trả giá đắt cho những lợi nhuận này: trong buổi ra mắt, ông đã khoe khoang rằng đã sử dụng 200.000 GPU H100 (tuyên bố "hơn 100.000" trong buổi phát trực tiếp) và đạt được tổng thời gian đào tạo là 200 triệu giờ. Điều này khiến một số người tin rằng nó đại diện cho một lợi ích đáng kể khác cho ngành công nghiệp GPU và coi tác động của DeepSeek đối với ngành này là "ngu ngốc". Đáng chú ý, một số người tin rằng sức mạnh tính toán tuyệt đối sẽ là tương lai của đào tạo mô hình.

Tuy nhiên, một số cư dân mạng đã so sánh mức tiêu thụ 2000 GPU H800 trong hai tháng để sản xuất DeepSeek V3, tính toán rằng mức tiêu thụ điện năng đào tạo thực tế của Grok3 gấp 263 lần so với V3. Khoảng cách giữa DeepSeek V3, đạt 1402 điểm, và Grok3 chỉ dưới 100 điểm. Sau khi dữ liệu này được công bố, nhiều người nhanh chóng nhận ra rằng đằng sau danh hiệu "mạnh nhất thế giới" của Grok3 là một hiệu ứng tiện ích cận biên rõ ràng—logic của các mô hình lớn hơn tạo ra hiệu suất mạnh hơn đã bắt đầu cho thấy lợi nhuận giảm dần.

Ngay cả với "điểm cao nhưng khả năng thấp", Grok2 vẫn có lượng lớn dữ liệu của bên thứ nhất chất lượng cao từ nền tảng X (Twitter) để hỗ trợ việc sử dụng. Tuy nhiên, trong quá trình đào tạo Grok3, xAI tự nhiên gặp phải "trần" mà OpenAI hiện đang phải đối mặt—việc thiếu dữ liệu đào tạo cao cấp nhanh chóng làm lộ ra tiện ích cận biên của các khả năng của mô hình.

Các nhà phát triển Grok3 và Musk có lẽ là những người đầu tiên hiểu và xác định sâu sắc những sự thật này, đó là lý do tại sao Musk liên tục đề cập trên phương tiện truyền thông xã hội rằng phiên bản mà người dùng đang trải nghiệm hiện nay "vẫn chỉ là bản beta" và "phiên bản đầy đủ sẽ được phát hành trong những tháng tới". Musk đã đảm nhận vai trò là người quản lý sản phẩm của Grok3, đề xuất người dùng cung cấp phản hồi về nhiều vấn đề khác nhau gặp phải trong phần bình luận. Ông có thể là người quản lý sản phẩm được theo dõi nhiều nhất trên Trái đất.

Tuy nhiên, trong vòng một ngày, hiệu suất của Grok3 chắc chắn đã gióng lên hồi chuông cảnh báo cho những ai hy vọng dựa vào "sức mạnh tính toán khổng lồ" để đào tạo các mô hình lớn mạnh hơn: dựa trên thông tin Microsoft công khai, GPT-4 của OpenAI có kích thước tham số là 1,8 nghìn tỷ tham số, gấp hơn mười lần so với GPT-3. Có tin đồn cho rằng kích thước tham số của GPT-4.5 thậm chí có thể lớn hơn.

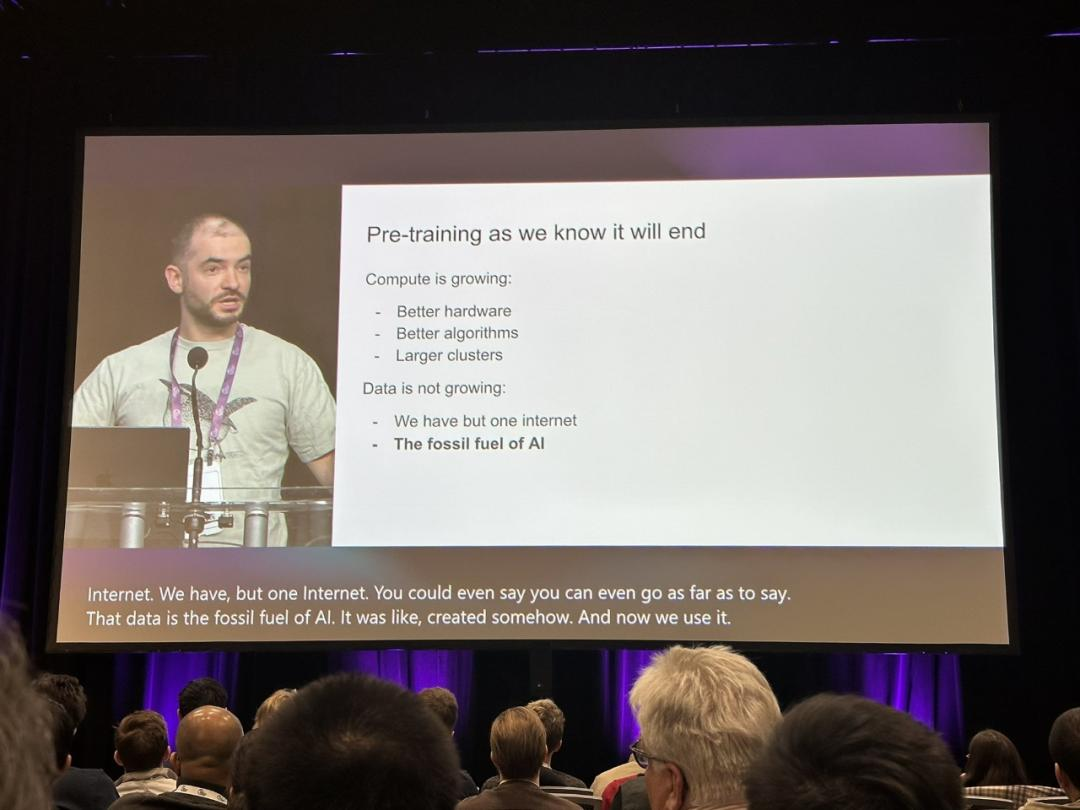

Khi kích thước tham số mô hình tăng vọt, chi phí đào tạo cũng tăng vọt. Với sự hiện diện của Grok3, các đối thủ cạnh tranh như GPT-4.5 và những đối thủ khác muốn tiếp tục "đốt tiền" để đạt được hiệu suất mô hình tốt hơn thông qua kích thước tham số phải xem xét đến giới hạn hiện đang rõ ràng và cân nhắc cách vượt qua nó. Vào thời điểm này, Ilya Sutskever, cựu nhà khoa học trưởng tại OpenAI, đã tuyên bố vào tháng 12 năm ngoái rằng "Quá trình đào tạo trước mà chúng ta quen thuộc sẽ kết thúc", điều này đã tái diễn trong các cuộc thảo luận, thúc đẩy các nỗ lực tìm ra con đường thực sự để đào tạo các mô hình lớn.

Quan điểm của Ilya đã gióng lên hồi chuông cảnh báo trong ngành. Ông đã dự đoán chính xác sự cạn kiệt sắp xảy ra của dữ liệu mới có thể truy cập được, dẫn đến tình huống mà hiệu suất không thể tiếp tục được cải thiện thông qua việc thu thập dữ liệu, ví von nó với sự cạn kiệt của nhiên liệu hóa thạch. Ông chỉ ra rằng "giống như dầu mỏ, nội dung do con người tạo ra trên internet là một nguồn tài nguyên hạn chế". Theo dự đoán của Sutskever, thế hệ mô hình tiếp theo, sau khi đào tạo trước, sẽ sở hữu "quyền tự chủ thực sự" và khả năng lý luận "tương tự như bộ não con người".

Không giống như các mô hình được đào tạo trước ngày nay chủ yếu dựa vào việc khớp nội dung (dựa trên nội dung mô hình đã học trước đó), các hệ thống AI trong tương lai sẽ có thể học và thiết lập các phương pháp để giải quyết các vấn đề theo cách tương tự như "suy nghĩ" của não người. Một con người có thể đạt được trình độ thành thạo cơ bản trong một môn học chỉ với tài liệu chuyên môn cơ bản, trong khi một mô hình AI lớn đòi hỏi hàng triệu điểm dữ liệu để đạt được hiệu quả cơ bản nhất ở cấp độ đầu vào. Ngay cả khi cách diễn đạt được thay đổi một chút, những câu hỏi cơ bản này có thể không được hiểu đúng, minh họa rằng mô hình chưa thực sự cải thiện về trí thông minh: những câu hỏi cơ bản nhưng không thể giải quyết được được đề cập ở phần đầu bài viết là một ví dụ rõ ràng về hiện tượng này.

Phần kết luận

Tuy nhiên, ngoài sức mạnh thô bạo, nếu Grok3 thực sự thành công trong việc tiết lộ với ngành công nghiệp rằng "các mô hình được đào tạo trước đang tiến gần đến hồi kết", điều này sẽ mang lại những ý nghĩa quan trọng cho lĩnh vực này.

Có lẽ sau khi cơn sốt xung quanh Grok3 dần lắng xuống, chúng ta sẽ chứng kiến nhiều trường hợp như ví dụ của Fei-Fei Li về "điều chỉnh các mô hình hiệu suất cao trên một tập dữ liệu cụ thể chỉ với 50 đô la", cuối cùng khám phá ra con đường thực sự dẫn đến AGI.

Cáp điều khiển

Hệ thống cáp có cấu trúc

Mạng & Dữ liệu, Cáp quang, Dây vá, Mô-đun, Mặt nạ

Ngày 16-18 tháng 4 năm 2024 Trung Đông-Năng lượng tại Dubai

Ngày 16-18 tháng 4 năm 2024 Securika tại Moscow

Ngày 9 tháng 5 năm 2024 SỰ KIỆN RA MẮT SẢN PHẨM & CÔNG NGHỆ MỚI tại Thượng Hải

Ngày 22-25 tháng 10 năm 2024 AN NINH TRUNG QUỐC tại Bắc Kinh

Ngày 19-20 tháng 11 năm 2024 THẾ GIỚI KẾT NỐI KSA

Thời gian đăng: 19-02-2025